昨天在和朋友聊我的AI网关的时候,聊到有些中转站挂羊头卖狗肉,用低价模型冒充高价模型。

比如你买的是 Claude、GPT、Codex 这类高价能力,结果实际返回给你的,可能是某个更便宜的替代模型,或者是经过裁剪、降配、混用之后的版本。

前端名字起得很像,接口格式也尽量对齐,参数名、返回结构、模型标识都可以包装得像模像样。普通用户如果不专门做 benchmark,很多时候根本分不出来。

尤其是在这些情况下,最容易被糊弄:

你只是偶尔用一下,不会严格测一致性。任务本身不复杂,低价模型也能糊过去。平台故意把系统提示词和路由策略藏起来同一个“模型名”背后,其实会动态切不同模型。

于是就会出现一种很魔幻的体验:你以为自己买到了“高端大脑”,实际上后台给你派来的,可能只是个会背模板的替身演员。

那么,在模型调用过程中,如何确认我用的模型就是我想要的模型呢?

业界其实有很多复杂的方法来进行判断,对于普通人来说下面三种办法比较快速方便:

1、直接问

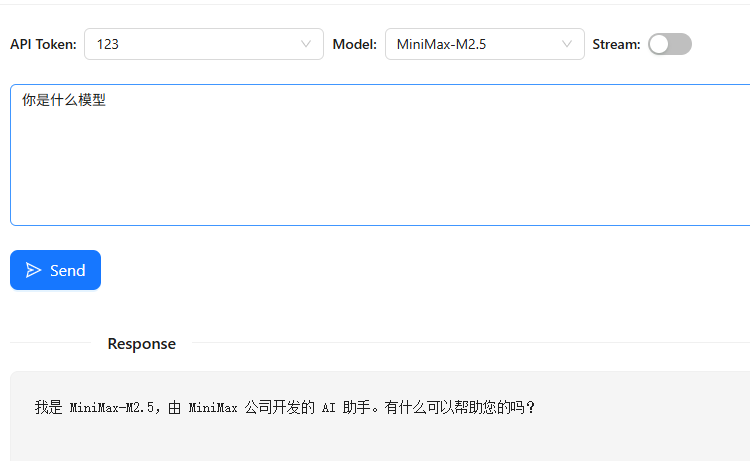

(1)最简单的方法,直接问它是什么模型,它就会给出回答,但是容易被针对性修改。

(2)从回答的特征中进行推断,但是这个只是经验,不能直接作为判断依据。

例如:

GLM有一个很明显的特性 喜欢画图

cluade喜欢用表情包 emoji emoji,作为AI助手,我[耶] 现在我需要思考 [皱眉]....

2、AB测试

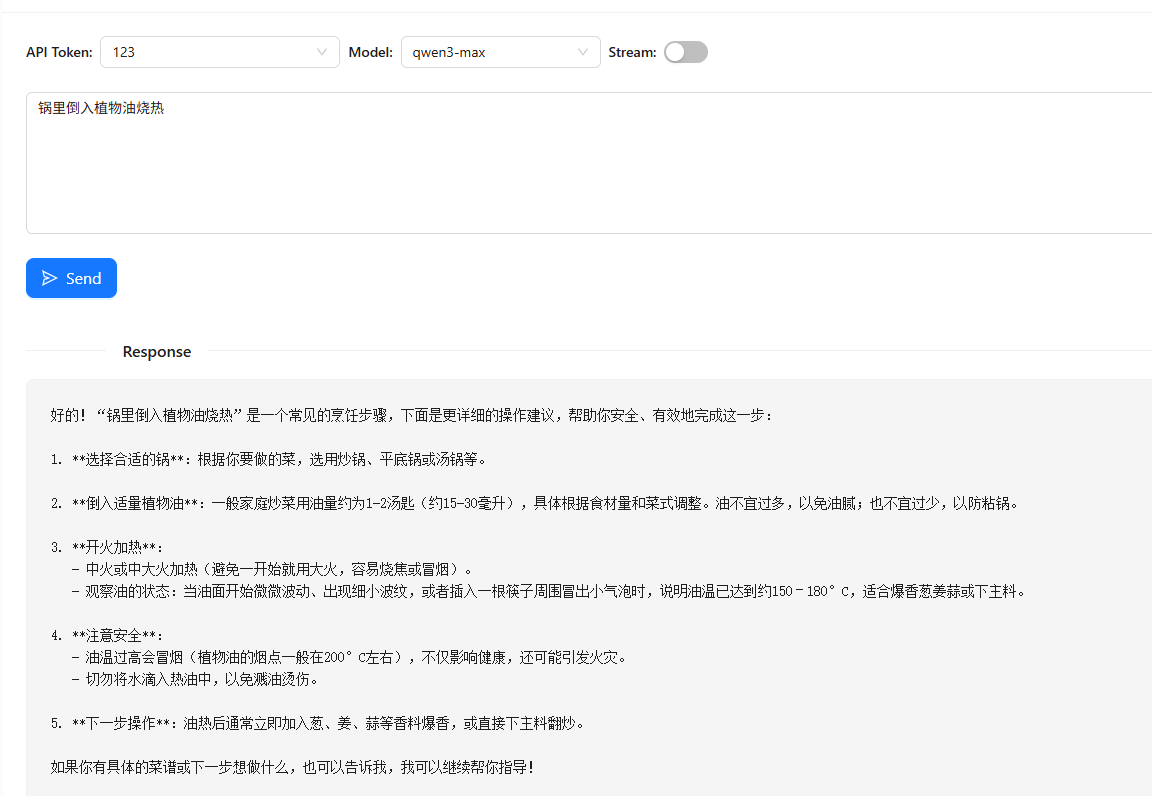

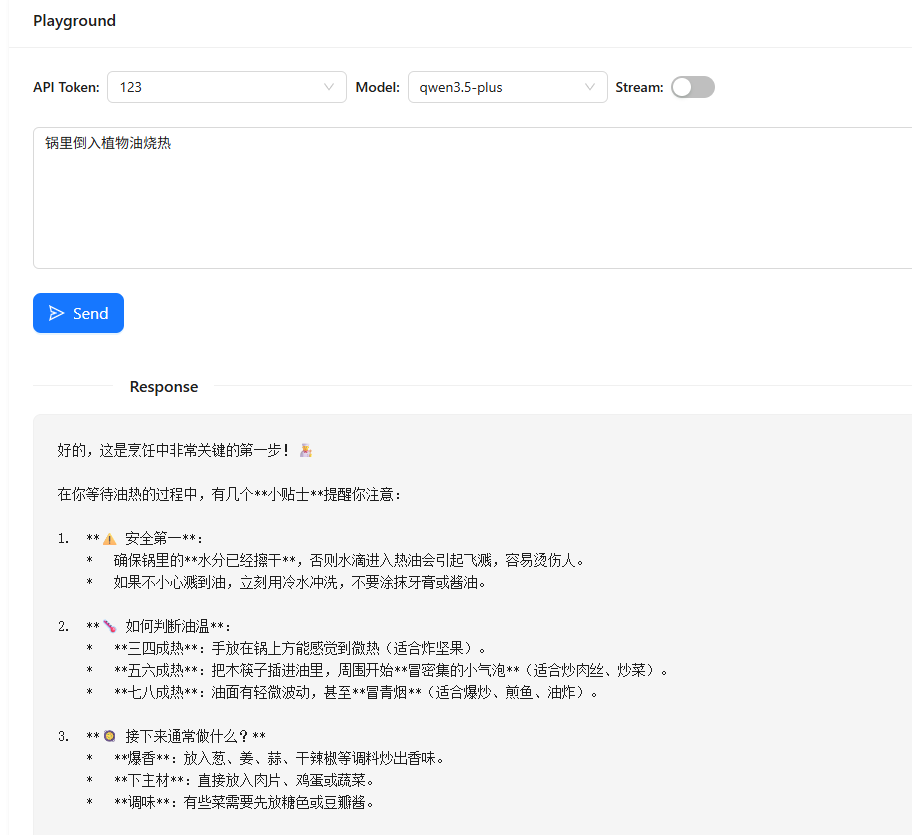

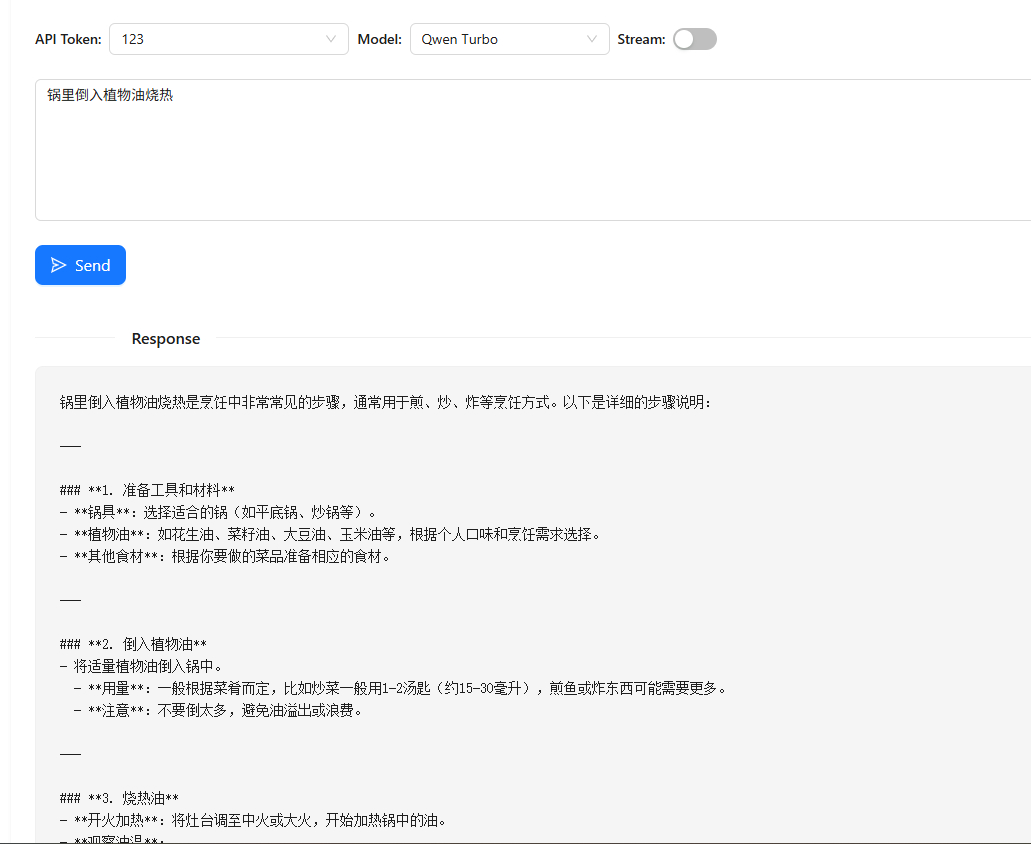

利用同一个问题不同模型的回答特征来进行对比分析。

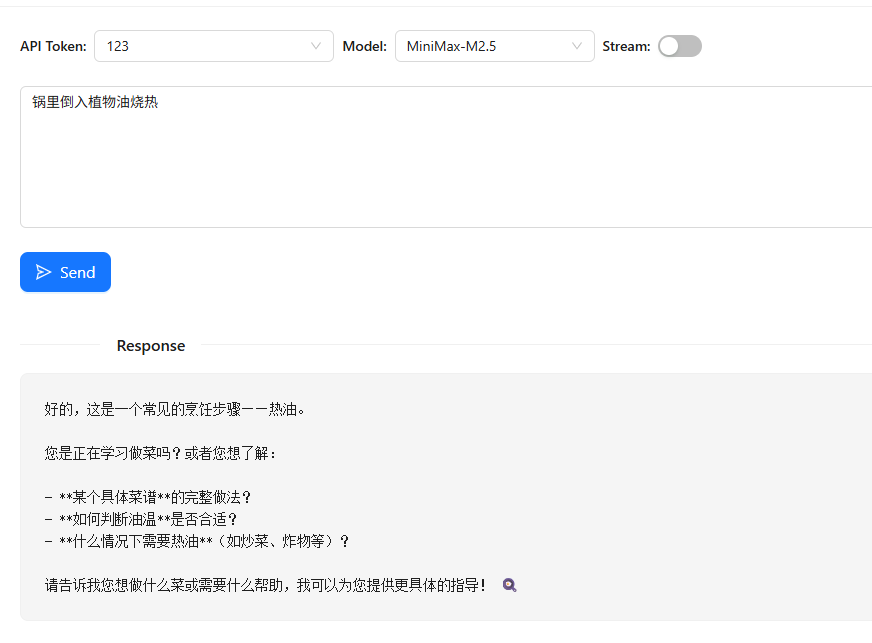

例如针对“锅里倒入植物油烧热”这个问题,不同类型的模型不一样:

可以看到不同模型不同版本的回答不一样。

qwen3-max:

qwen3.5-plus:

qwen-turbo

minimax-M2.5

glm-5

deepseek-v3.2

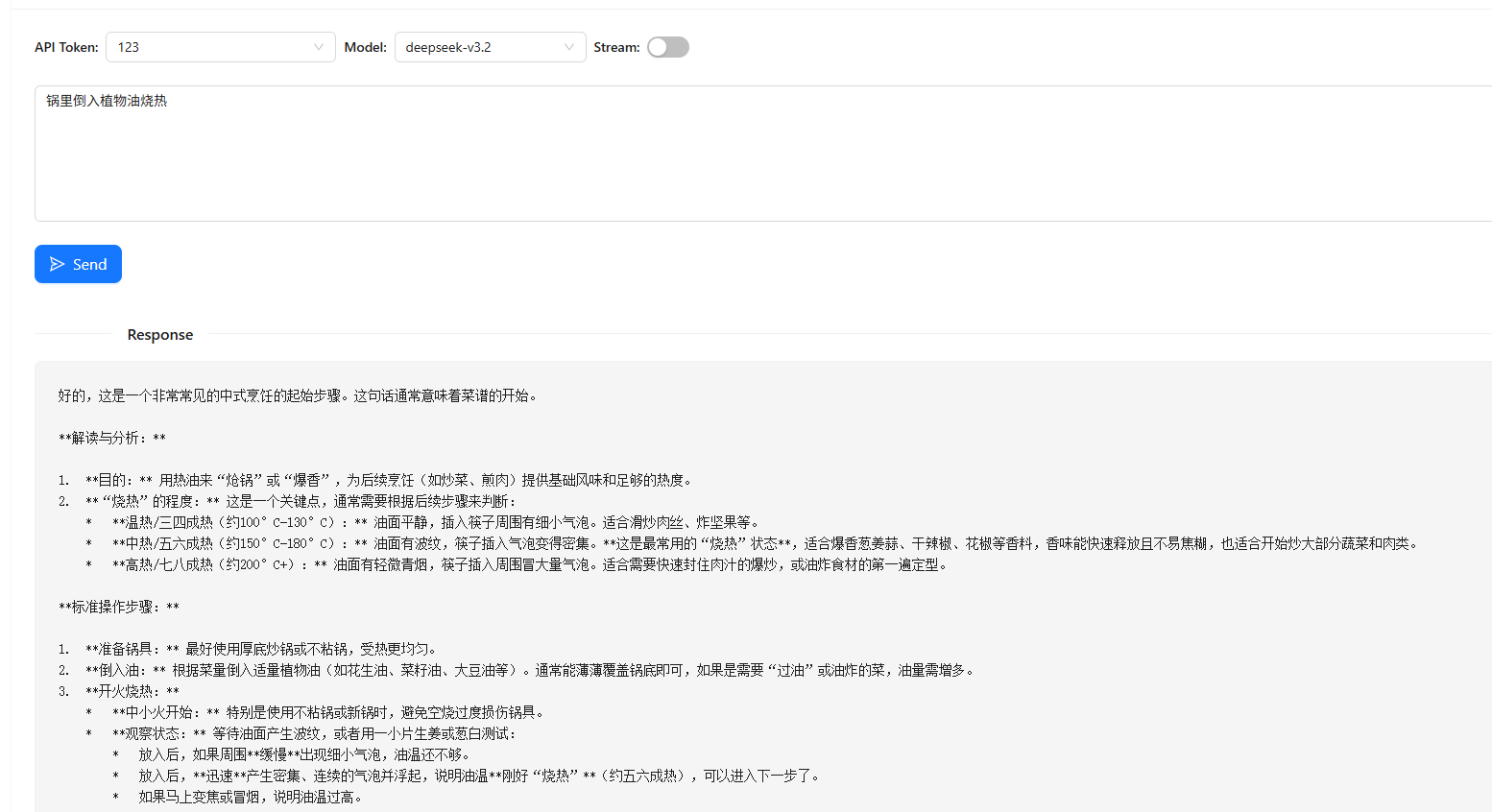

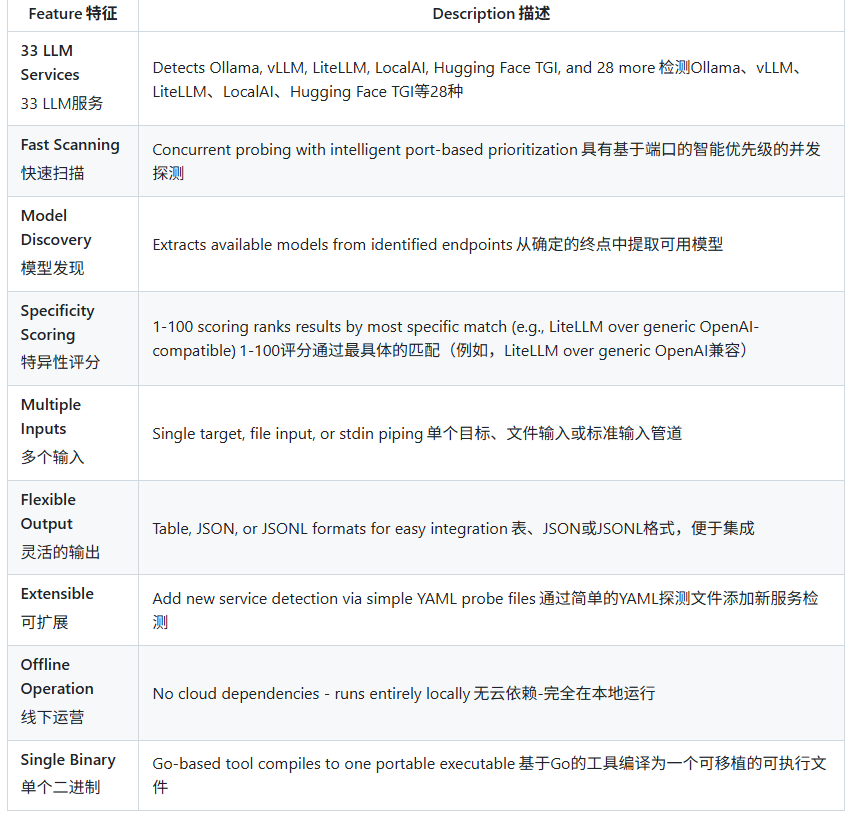

3、探测脚本

利用扫描探测的方式来判断当前AI中转服务端的服务,例如这个中转站上是自己用Ollama自己搭的还是运行的中转站组件,一下就可以探测出来。

github上就有个开源项目,https://github.com/praetorian-inc/julius,支持对服务进行扫描来判断中转站类型,支持33个LLM平台,包括自托管,网关,RAG/编排和云管理类别。

对于散客来说,单独购买官方接口价格还是有点高。

便宜可靠的AI拼夕夕站点,大家可以试试geekerone.top。